Marzo 1981

| L | M | X | J | V | S | D |

|---|

Cada robot de hidrogel está formado por un conjunto de estructuras similares a músculos conectados entre sí por tubos que inflan o vacían de agua sus cavidades. Esto permite a los robots estirarse o adoptar formas complejas.Entre sus ventajas, la más destacable por su posible aplicación médica, es el uso de estos robots de materiales amigables para los órganos, en operaciones o tareas en las que haya que manipular órganos internos con mayor suavidad, ofreciendo un tacto similar a unas manos. Hasta ahora existían experimentos previos con materiales de silicona, que son menos biocompatibles que los hidrogeles, compuestos básicamente de agua. Para aplicar sus materiales de hidrogel blando a la robótica, los investigadores se fijaron primero en el mundo animal. Se concentraron en particular en leptocéfalos, o anguilas diminutas transparentes. «Parece que trataron de evolucionar a una forma transparente como una táctica de camuflaje eficiente” explican los científicios “Y queríamos alcanzar un nivel similar de transparencia, fuerza y velocidad.» De hecho, uno de los primeros experimentos que realizaron una vez conseguida la estructura con impresión 3D, fue sumergirla en un tanque de agua con peces y capturarlos con ella. Midieron las propiedades acústicas y ópticas de los robots de hidrogel, y se encontraron que eran casi iguales a las del agua . «El robot es casi transparente, muy difícil de ver» —dice el profesor Xuanhe Zhao, uno de los investigadores— “Es suave y no daña a los peces. Una mano robótica con fuerza probablemente los aplastaría.” Fuente: MIT Otros animales como los murciélagos también han inspirado a los científicos para desarrollar robots más eficaces en tareas como el vuelo. Investigadores de la Universidad de Illinois han creado un robot autónomo de murciélago llamado Bat Bot (B2) con suaves alas articuladas que pueden imitar los mecanismos clave del vuelo de los murciélagos biológicos. Pesa sólo 93 gramos y posee ventajas frente a drones cuatrimotores. Los murciélagos tienen más de 40 articulaciones activas y pasivas que han sido reducidas a 9 (5 activass y 4 pasivas) en las articulaciones del robot B2. Las frecuencias de aleteo de un murciélago robot son más bajas (7-10 Hz) que las de un cuadrotor (100-300 Hz). Además son inherentemente seguros porque sus alas están fabricadas principalmente con materiales flexibles y son capaces de chocar unos con otros, o con obstáculos en su entorno, con poco o ningún daño.

El diseño propuesto por el equipo de la Universidad de Illinois, también aporta mayor eficiencia energética, gracias a que la flexibilidad del ala amplifica el movimiento y requiere menos consumo.«Cuando un murciélago bate sus alas, es como una hoja de goma» —explica el profesor Hutchinson, de la Facultad de Ingeniería Eléctrica e Informática en Illinois— «Se llena con el aire y se deforma. Y luego, al final de su movimiento de carrera descendente, el ala empuja el aire hacia fuera cuando vuelve a su sitio. Puede obtener esta gran amplificación de la energía que se produce tan sólo por el hecho de que están utilizando membranas flexibles dentro de la propia ala «. fuente: Illinois.edu

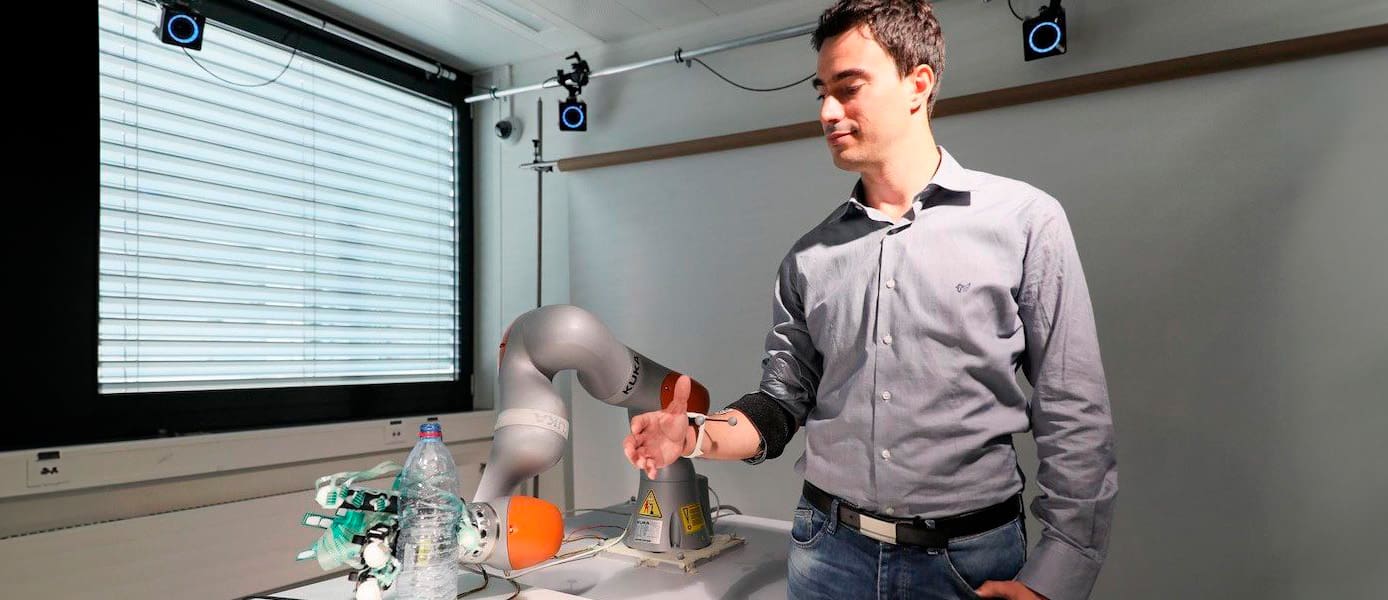

El dispositivo empleado por la empresa británica SitexOrbis contiene un botón de pánico que utiliza una amplia gama de tecnologías para localizar con precisión y rapidez el usuario.Una vez que se activa la alerta roja, el dispositivo se conecta a los operadores dedicados que trabajan 24/7 que va a escuchar la llamada, evaluar la situación, localizar el trabajador y coordinar una respuesta adecuada – convocar a los servicios de emergencia si es necesario. También da acceso las 24 horas a las funciones de seguimiento adicionales, con características de mapeo que incluyen la última ubicación conocida, actualizaciones de posición continua y controles de seguridad automatizadas. Dos niveles de alerta están disponibles, ámbar y rojo. Cuando se activa el ámbar las llamadas comenzarán a grabarse después de dos segundos. La activación de una alerta roja da la alarma y permite a un operador del centro de respuesta escuchar la situación en vivo. Cualquier alerta pre-grabada se pueden escuchar al mismo tiempo y dar al equipo un cuadro completo de la situación. La ubicación del usuario se comprueba mediante GPS y se inicia la respuesta apropiada. En ambos casos las llamadas se registran inmediatamente y pueden ser utilizados como prueba en los tribunales. Herramientas de información, gestión de usuario basada en web y la presentación de informes en tiempo real ayudan a analizar el riesgo de manera más rápida y eficaz, lo que le da un mayor grado de control.